Deepfakes: wat als Artificial Intelligence je voor de gek houdt?

Net als bij de komst van het internet staan we opnieuw aan de vooravond van een technologische revolutie. Kunstmatige intelligentie gaat de komende jaren de samenleving én de journalistiek radicaal veranderen. In het laatste deel (4) van onze serie: deepfakes, en wat er gebeurt als Artificial Intelligence je voor de gek houdt.

Beeld en tekst zijn niet altijd door mensen gemaakt. Steeds vaker komt er een computer aan te pas. Synthetische media - deepfakes, computerstemmen en gegenereerde artikelen - liggen op de loer. Welke impact heeft dat voor de rol van de journalist?

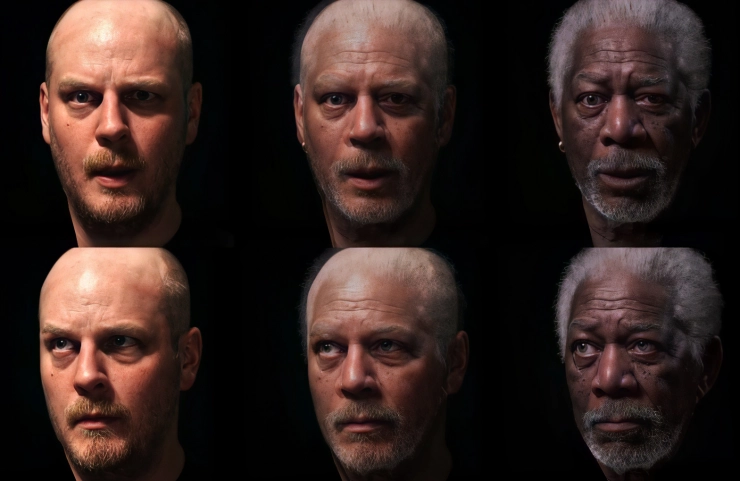

Op je scherm staat onmiskenbaar Morgan Freeman. Zijn grijze haar, vlekjes in zijn gezicht, oorbelletje net zichtbaar. Zijn donkerbruine ogen fonkelen. Zijn diepe stem herken je uit duizenden. Alleen, dit is niet de acteur, zo vertelt zijn levensechte avatar in de video. Het is een project van de Amsterdamse filmmaker Bob de Jong die zijn deepfake creaties onder de naam Diep Nep publiceert.

De Jong raakte door de coronacrisis veel klussen kwijt en besloot uit tijdverdrijf te experimenteren met de technologie. Het zou leuk zijn als er wat uit komt, zo dacht hij. Hij begon met Nederlandse figuranten in grappige video’s. Onder meer Louis van Gaal, Maxime Hartman en Hugo de Jonge kwamen voorbij. De internationale doorbraak kwam met Freeman. Inmiddels heeft Diep Nep 150.000 volgers op TikTok en zijn de video’s miljoenen keren gedeeld.

Grappige deepfake video’s kom je op het internet geregeld tegen. Ook Tom Cruise moet er aan geloven in de vele levensechte producties van de Vlaamse filmmaker Chris Umé. Bruce Willis besloot er zelfs een slaatje uit te slaan. Hij verkocht zijn deepfake aan een reclamevideo van een Russische telecomprovider. Zelfs thuis kun je ermee experimenteren. Met apps als ReFace plak je het gezicht van jezelf of een bekende in een handomdraai op die van een acteur in een bekende filmscène.

Tegelijkertijd worden ook de negatieve gevolgen van de technologie meer duidelijk: zoals gezichten van beroemdheden die op het lichaam van een pornoactrice worden geplakt. Of recentelijk de rel rondom Leonid Volkov, stafchef van de opgepakte Putin-criticus Alexei Navalny, die als deepfake leden van de Tweede Kamer zou hebben toegesproken. De laatste bleek uiteindelijk een acteur met gelijkenis tot Volkov te zijn, maar de angst dat de menselijke figurant binnen enkele jaren overbodig zou zijn, was duidelijk voelbaar.

Dat deepfakes effect hebben op de publieke opinie, blijkt uit onderzoek van Tom Dobber van de Universiteit van Amsterdam. Dobber wilde weten of argeloze kijkers door hebben wanneer beelden gemanipuleerd zijn om politieke desinformatie te verspreiden. Daarnaast werd gekeken of de mening van de kijker over de getoonde politicus was bijgesteld na het zien van de beelden.

Voor het onderzoek dat in 2018 plaats vond, koos Dobber om een deepfake te maken van toenmalig CDA-lijsttrekker Sybrand van Haersma Buma. ‘Ik wilde weten hoe makkelijk het was om zo’n video te maken. De keuze voor Buma was betrekkelijk eenvoudig. Hij had lang in de politiek gezeten, dus een grote naamsbekendheid. Bovendien zou hij kort erna afzwaaien, waardoor de deepfake geen grote politieke gevolgen kon hebben.’

Het experiment werkte als volgt: de kijker zag een nieuwslezer die vertelde dat Buma in een talkshow een opmerkelijke uitspraak had gedaan. Vervolgens zagen ze Buma aan tafel bij een talkshow waarin zijn gemanipuleerde evenknie verkondigt: ‘Zoals Christus zou zeggen, pin mij er niet op vast’. ‘Het is een vrij onschuldig grapje, maar voor iemand die de christelijke waarden omarmt wel een opvallende’, stelt Dobber. ‘Slechts een handjevol mensen had door dat het hier niet ging om de “echte” Sybrand Buma. Terwijl een groot deel van de kijkers hem na het zien van de video wel degelijk slechter beoordeelt.’

Dobber koos ervoor om zijn deepfake uit het onderzoek niet te publiceren: ‘Dat hebben we gedaan uit ethische overwegingen. Buma is natuurlijk een echt persoon die deze woorden nooit gezegd heeft. Als de beelden zouden circuleren zouden mensen echt de verkeerde indruk van hem kunnen krijgen. Dat was uiteraard niet onze bedoeling.’

Technologie-expert Jarno Duursma spreekt regelmatig op landelijke podia over de impact van synthetische media. Hij liet zowel zijn stem klonen als zijn gezicht omtoveren tot virtuele avatar, die hij gebruikt als voorbeeld om de mogelijkheden van de techniek te duiden. Duursma ziet een aantal gevaren van gegenereerde beelden, audio en tekst voor de journalistiek.

‘Daarbij moet je denken aan reputatieschade, chantage en identiteitsfraude. Kwaadwillenden kunnen deze technologie gebruiken om individuele journalisten die ongunstige verhalen over ze publiceren in diskrediet te brengen of onder druk te zetten. In India heeft een kritische journalist hier veel problemen van ondervonden toen een deepfake pornovideo van haar verscheen. Het kan ook persoonlijk worden; dat een onbekende dreigt een deepfake pornovideo van je partner of kind te verspreiden als je over een bepaald onderwerp schrijft. Je zal je mogelijk toch afvragen: is dit verhaal het mij wel waard?’

‘Tot slot moet je rekening houden dat je stem kan worden gekloond. Stel je bent met een onderzoeksverhaal bezig en plots wordt je gebeld door een collega met de vraag of je hem of haar een paar bestanden kunt toesturen. Je vertrouwt het misschien, want het klinkt precies als die persoon. Of dat bronnen een voicemail ontvangen met jouw stem, met de vraag ze nog een keer die belastende informatie kunnen nasturen omdat je computer gecrasht zou zijn. Voor dergelijke vormen van manipulatie moeten we meer en meer waakzaam zijn.’

Ook stelt Duursma dat journalisten oog moeten hebben voor de zogeheten liar’s dividend. Dit betekent dat publieke figuren baat kunnen hebben bij de schijn van misinformatie. Wanneer ze negatief in het nieuws komen, kunnen ze immers pleiten dat beelden deepfake zijn of dat hun stem is nagebootst. Om zo verwarring of verdeeldheid te zaaiend onder de kijkers.

Spannende ontwikkelingen, maar tegelijkertijd verwacht hoogleraar Kunstmatige Intelligentie Eric Postma van de Tilburg Universiteit dat de impact van synthetische media op de journalistiek en de maatschappij zal meevallen. Manipulatie is van alle tijden. Denk aan de foto’s in de Sovjet Unie die werden aangepast. Het grote verschil is dat het nu op grotere schaal kan gebeuren. Journalisten zullen daarom een belangrijkere rol krijgen als hoeders van de waarheid en democratie. Zij hebben immers de kennis en middelen om feiten te verifiëren. Je moet niet klakkeloos video’s van sociale media doorplaatsen op een nieuwssite, zonder dat de authenticiteit is bevestigd.

Bovendien wordt in het debat rondom deepfakes erg de nadruk gelegd op computersystemen die ons zouden willen bedonderen. Het grootste gevaar zit nog steeds bij de mensen: die liegen al sinds mensenheugenis. In dat opzicht zijn mensen net zo verdacht als AI-systemen. Ik heb bovenal vertrouwen in het aanpassingsvermogen van de mens. We gaan leren omgaan met het bestaan van deze technieken.’

Hoe moeilijk is het eigenlijk om een deepfake te maken? Dat hangt af van de mate van realisme die je wilt nastreven, stelt filmmaker De Jong. ‘Voor een haarscherpe video zoals die van Morgan Freeman, gaat buitengewoon veel werk zitten in de nabewerking. De huidige algoritmes leveren vaak vertekeningen in het beeld op, die weggepoetst moeten worden. Die handmatige nabewerking kost soms weken werk. Bovendien vindt de software het lastig als er een object voor het beeld langs komt, of om bepaalde details zoals haartjes te genereren.’

Voor de virtuele avatar van Duursma moest de toekomstverkenner een middag de studio in. ‘Ik maak gebruik van de online tool Synthesia. Die heeft kant-en-klare acteurs in de aanbieding als virtuele spreekpop, maar ik wilde graag mijzelf digitaliseren. Daarvoor is een filmploeg in de weer geweest. Om mijn stem na te bootsen moest ik een half uur een script voorlezen in het programma Descript waardoor de software de verschillende klanken van mijn stem kon herkennen. Het duurde vervolgens zes weken tot de avatar klaar was voor gebruik. Nu tik ik online een tekst in en spreekt mijn virtuele gelijkenis het uit.’

Ook Dobber heeft een flinke kluif gehad aan zijn Buma-onderzoek. ‘Het was gigantisch veel werk om de computer te voeden met voldoende data. We hebben denk ik dertig uur aan video’s uitgezocht van eerdere tv-optredens waar Buma recht de camera in kijkt. Alle andere beelden moesten weggeknipt worden, om het systeem niet in de war te brengen. Vervolgens kostte het dagen aan serverkracht om het filmpje te laten renderen. Kortom: voor een paar seconden video was ik weken bezig. En zelfs toen was het van een dusdanige kwaliteit dat ik had verwacht dat mensen zouden zien dat er met het beeld gerommeld was. Dat bleek echter niet zo te zijn. Toegegeven: deze techniek kwam uit 2018, inmiddels gaat het waarschijnlijk een stuk sneller om een deepfake te maken.’

Belangrijker dan het maken, is misschien wel hoe je deepfakes en andere vormen van beeldmanipulatie kunt herkennen. Gelukkig zijn realistische deepfakes nog steeds lastig te maken. Wie doelbewust misinformatie wil verspreiden kan dat op andere manieren vaak makkelijker, goedkoper en efficiënter doen. Bovendien zijn er verschillende algoritmes die zich specialiseren in het herkennen van deepfakes. Onder meer Microsoft en het Nederlandse 3Duniversum en Sensity maken hier tools voor.

‘Tegelijkertijd is het goed om te beseffen dat het een continue wapenwedloop is tussen de ontwikkelaars van deepfakes en de ontwikkelaars van de software die ze willen detecteren’, stelt hoogleraar Postma. ‘Je kunt dus niet blindelings vertrouwen op deze detectiesoftware, maar het kan je zeker helpen. Ze kunnen dikwijls afwijkingen in het beeld zien, die een mens met het blote oog zou missen.’

Kortom: hoe groot is het gevaar van synthetische media? ‘Enerzijds zijn deepfakes the dog that never barked’, stelt Duursma. ‘We zijn doodsbang om voor de gek gehouden te worden door computers, maar in de praktijk moet je meer vrezen voor mensen die desinformatie en leugens verspreiden, en dat zijn heus niet altijd alleen complotdenkers. Als gemanipuleerde beelden vaker voorbij gaan komen, omdat de techniek bijvoorbeeld toegankelijker wordt, bestaat er de kans dat mensen meer onverschillig worden voor nieuwsberichten. Ze zullen zich bij alles kunnen afvragen of iets echt is of nep. Tegelijkertijd brengt de technologie ook kansen. Zo zou je in de toekomst ervoor kunnen kiezen om het nieuws weer te laten voorlezen door Joop van Zijl. Het zal nog wel even duren voordat we daar zijn.’

Voor één iemand heeft de interesse voor deepfakes goed uitgepakt. De agenda van De Jong zit na de dip tijdens de coronapandemie, weer tot de nok toe gevuld. Door de wereldwijde aandacht voor Diep Nep weten ook de filmstudio’s in Amerika hem te vinden. Deepfakes op het grote doek zijn immers steeds vaker gemeen goed. Zo werd een overleden acteur uit de originele Star Wars-triologie tot leven gewekt in de recente films en maakte Martin Scorsese voor ‘The Irishman’ Robert De Niro en Al Pacino middels algoritmes jaren jonger. De Jong is ondanks de nieuwe inkomstenbron nog wel wat sceptisch over de technologie: ‘Of nog meer special effects de kwaliteit van films ten goede komt, ik weet het niet. In feite is AI gewoon doping voor video.’

De serie artikelen over kunstmatige intelligentie wordt mede mogelijk gemaakt door het Lucas Ooms Fonds.

Praat mee